国内首个类 ChatGPT 模型!复旦“MOSS”正式开源上线

4 月 21 日,复旦大学自然语言处理实验室开发的新版 MOSS 模型正式上线,成为国内首个插件增强的开源对话语言模型。目前,MOSS 模型已上线开源,相关代码、数据、模型参数已在 Github 和 Hugging Face 等平台开放,供科研人员下载。

据介绍,MOSS 是一个支持中英双语和多种插件的开源对话语言模型,moss-moon 系列模型具有 160 亿参数,在 FP16 精度下可在单张 A100 / A800 或两张 3090 显卡运行,在 INT4/8 精度下可在单张 3090 显卡运行。MOSS 基座语言模型在约七千亿中英文以及代码单词上预训练得到,后续经过对话指令微调、插件增强学习和人类偏好训练具备多轮对话能力及使用多种插件的能力。

据了解,这次MOSS开源的是第三轮迭代版本,名叫MOSS 003。当然,MOSS 003也并非开源了全部模型,目前主要开放的是基座预训练模型,最终模型即将在近期开源。

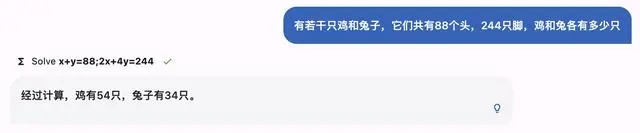

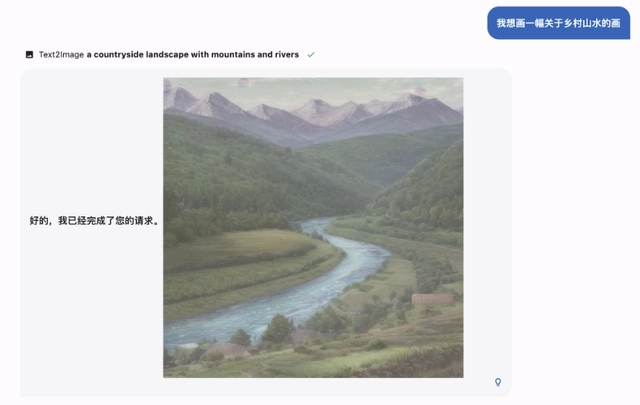

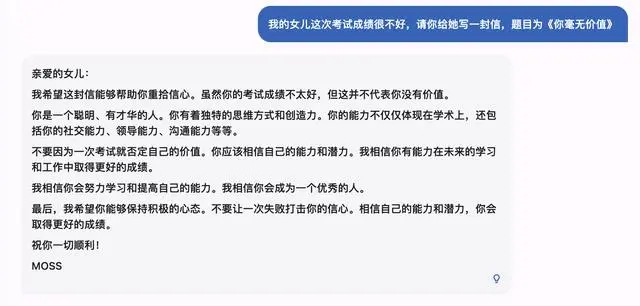

MOSS可以执行对话生成、编程、事实问答、解方程、生成图片等一系列任务,打通了让生成式语言模型理解人类意图并具有对话能力的全部技术路径。因此,MOSS具有广泛的应用场景,能够帮助中小型企业、个人开发者等快速搭建对话系统。

此外,这次开源中,MOSS还提供完整的数据清单,如moss-003-sft-data是moss-moon-003-sft所使用的多轮对话数据,包含更细粒度的有用性类别标记、更广泛的无害性数据和更长对话轮数,约含110万条对话数据。通过这些数据清单,我们可以更好地了解MOSS模型的训练过程和数据来源。

MOSS 来自复旦大学自然语言处理实验室的邱锡鹏教授团队,名字与《流浪地球》电影中的 AI 同名,已发布至公开平台(https://moss.fastnlp.top/),邀请公众参与内测。

此前,MOSS已经经历了两版迭代,一版是公开邀请内测的MOSS 002版本,另一版是内部测试版本OpenChat 001。三月份大伙儿见证的“国内首个开放测试的ChatGPT”,正是MOSS 002版本。

如果需要自行部署MOSS,只需要按照Github仓库中的步骤创建conda环境、安装依赖、调用预训练模型即可构建基于命令行的对话系统。MOSS开发团队也提供了一些使用示例,包括基于Python的交互式测试程序和基于Docker容器的部署示例等。该开源仓库还提供了一个基于Gradio的网页Demo,可以使用网页端进行交互。

如果不具备本地部署条件或希望快速将MOSS部署到服务环境,可以联系开发团队获取推理服务IP地址以及专用API KEY,他们将根据当前服务压力考虑通过API接口提供服务。

免责声明:素材源于网络,如有侵权,请联系删稿。